Testy A/B powiadomień push (zwane też split testingiem) polegają na wysyłaniu dwóch wersji tego samego powiadomienia do różnych segmentów odbiorców, pomiarze wyników i wdrożeniu wariantu, który wypadł lepiej. Między wersjami zmienia się jedna zmienna. Reszta pozostaje taka sama.

Ten warunek jest kluczowy. Jeśli warianty różnią się jednocześnie treścią, czasem wysyłki i emoji, nie ma możliwości stwierdzenia, co wpłynęło na wynik. Jedna zmiana na raz.

Przewodnik obejmuje: co testować, jak zbudować test A/B, jak odczytywać wyniki i jak unikać błędów, które sprawiają, że testy wprowadzają w błąd.

Dlaczego należy wykonywać testy A/B powiadomień push?

Samo przetestowanie czasu wysyłki może zwiększyć reaction rate o 40% (Business of Apps, 2025). W połączeniu z zaawansowaną segmentacją testy A/B mogą podnieść reaction rate nawet o 300%. To nie efekt kompleksowego przebudowania strategii push. To wynik systematycznego testowania jednej rzeczy na raz i przenoszenia zwycięskiego wniosku do następnej kampanii.

Bez testowania w każdej kampanii podejmujesz te same założenia i liczysz, że wyniki się poprawią. Zazwyczaj się nie poprawiają.

Struktura kampanii A/B push: zmienne i pola

Większość platform push reprezentuje test jako kampanię nadrzędną z dwoma lub więcej obiektami wariantów. Kluczowe pola, z którymi będziesz pracować:

| Pole | Opis |

|---|---|

campaign_id | Unikalny identyfikator testu nadrzędnego |

variant_id | Identyfikator każdego wariantu (A, B, C…) |

audience_split | Procent całkowitej bazy odbiorców na wariant (np. 50/50) |

control_group | Opcjonalne: procent wykluczony ze wszystkich wariantów (punkt odniesienia) |

variable | Co różni się między wariantami (treść, obraz, czas, CTA) |

success_metric | Główny KPI: CTR, open rate, współczynnik konwersji |

duration | Jak długo test działa przed odczytem wyników |

winner_selection | Ręczne lub automatyczne wdrożenie zwycięskiego wariantu |

Przy uruchamianiu testów przez API zamiast dashboardu, pola te mapują się bezpośrednio na payload kampanii. Pole variable jest tu krytyczne: jeśli między A, a B różni się więcej niż jedna rzecz, wyniki są nieczytelne.

Co testować w powiadomieniach push

Nie każda zmienna wpływa na CTR w równym stopniu. Zacznij od tych, które zwykle przynoszą największy efekt:

| Zmienna | Co testować | Typowy wpływ |

|---|---|---|

| Treść wiadomości | Sformułowanie tytułu, struktura zdania, długość | Wysoki |

| Tekst CTA | „Kup teraz” vs „Zobacz ofertę” vs „Odbierz rabat” | Wysoki |

| Emoji | Z emoji vs bez; różne zestawy emoji | Średnio-wysoki |

| Czas wysyłki | Rano vs wieczór; dzień roboczy vs weekend | Wysoki |

| Grafika (rich push) | Zdjęcie produktu vs lifestyle vs sam tekst | Średnio-wysoki |

| Ton | Formalny vs konwersacyjny vs pilny | Średni |

| Personalizacja | Z imieniem użytkownika vs bez | Średni |

| Segmentacja | Ta sama wiadomość do różnych grup odbiorców | Wysoki |

Treść wiadomości

Tytuł to miejsce, gdzie dzieje się największa część roboty. Testuj sformułowania, długość i strukturę zdania. Krótko i bezpośrednio zwykle wygrywa: powiadomienia z 10 słowami lub mniej konsekwentnie osiągają najlepsze CTR we wszystkich branżach (Business of Apps, 2025). „Konsekwentnie” to nie „zawsze”. Dlatego właśnie testujesz.

CTA i przyciski akcji

„Kup teraz” i „Odbierz swój rabat” mogą generować znacząco różne CTR nawet przy identycznej ofercie. Jeśli używasz przycisków akcji w rich push notifications, testuj etykiety przycisków osobno od treści powiadomienia.

Emoji

Badanie HubSpot wykazało, że powiadomienia z emoji osiągają o 85% wyższy open rate niż te bez. Business of Apps podaje wzrost reaction rate na poziomie 20%. Liczby różnią się w zależności od źródła, ale kierunek jest spójny. Zacznij od testu „z emoji vs bez”, a gdy już wiesz, że Twoi odbiorcy na nie reagują, przejdź do testowania konkretnych zestawów.

Czas wysyłki

Wtorek konsekwentnie notuje najwyższy globalny reaction rate push na poziomie 8,4%; niedziela jest na drugim miejscu z 8,1% (Business of Apps, 2025). To uśrednienia z milionów wysyłek z każdego rodzaju aplikacji. Są punktem wyjścia, nie gotowym harmonogramem. Przetestuj zachowanie swojej konkretnej bazy odbiorców przed ustaleniem okna wysyłki.

Rich media

Rich push notifications z obrazami osiągają CTR 9,2% wobec 6,9% dla zwykłego tekstu. Jeśli nie testowałeś jeszcze rich vs standard w swoich kampaniach, to pierwszy test wart przeprowadzenia. Po nim testuj typy obrazów: zdjęcia produktowe vs lifestyle vs banery promocyjne.

Formułowanie hipotezy

Test bez hipotezy to po prostu wysyłanie dwóch powiadomień i wybieranie tego, które wypadło lepiej. To nie jest testowanie. To szczęście z dodatkowym krokiem.

Użyteczna hipoteza jest na tyle konkretna, żeby można ją było obalić:

Zbyt ogólna: „Dodanie emoji poprawi wyniki.”

Użyteczna: „Dodanie emoji ognia 🔥 do tytułu powiadomień o wyprzedaży flash zwiększy CTR o co najmniej 10% w porównaniu z tym samym tytułem bez emoji, mierzony w segmencie 25–34 lata.”

Druga wersja mówi dokładnie co mierzysz, co liczy się jako sukces i do której grupy odbiorców ma zastosowanie. Mówi też kiedy test się nie powiódł. To ta część, którą ludzie pomijają.

Wielkość próby i istotność statystyczna

Najczęstszy powód, dla którego wyniki testów A/B push nie są powtarzalne, to zbyt mała próba. Test przeprowadzony na kilkuset użytkownikach pokaże pozornych zwycięzców, którzy znikają przy skalowaniu do pełnej bazy.

Praktyczna wskazówka: każdy wariant powinien trafić do co najmniej kilku tysięcy odbiorców przed wyciąganiem wniosków. Dokładny próg zależy od bazowego CTR i wielkości różnicy, którą chcesz wykryć. Uruchomienie testu na 10–20% listy przed wyborem zwycięzcy daje zazwyczaj bardziej wiarygodne dane niż podział 50/50 na małej bazie.

Nie zatrzymuj testu wcześnie dlatego, że jeden wariant prowadzi. Wczesne wyniki bardzo często się odwracają wraz z rosnącą próbą.

Jak testować powiadomienia push bez spamowania realnych użytkowników

Segmenty testowe: Kieruj warianty do zdefiniowanych pod-segmentów zamiast całej listy. Użyj filtrów behawioralnych lub demograficznych, żeby stworzyć grupy wystarczająco duże dla istotności statystycznej, ale wystarczająco małe, żeby ograniczyć ekspozycję.

Tokeny sandbox: FCM i APNs obsługują testowe tokeny urządzeń. Zarejestruj konkretne urządzenia jako cele testowe i wysyłaj payloady bezpośrednio na te tokeny, nie dotykając produkcyjnej bazy odbiorców.

Testowanie wewnętrzne: Wyślij warianty do swojego zespołu lub urządzeń QA przed wyjściem na żywo. To wyłapuje problemy z renderowaniem, uszkodzone deep linki i błędy wyświetlania. Nie da ci danych o zaangażowaniu.

Grupy holdout: Zarezerwuj procent bazy odbiorców, który nie otrzymuje żadnego powiadomienia. To pozwala mierzyć lift kampanii jako całości, a nie tylko między wariantami.

MessageFlow obsługuje segmentację odbiorców i grupy holdout z poziomu kreatora kampanii. Szczegóły konfiguracji znajdziesz na stronie platformy MessageFlow Mobile Push.

Metryki do śledzenia

| Metryka | Co mówi |

|---|---|

| Click-through rate (CTR) | Procent odbiorców, którzy kliknęli powiadomienie |

| Open rate | Procent, którzy otworzyli aplikację przez powiadomienie |

| Współczynnik konwersji | Procent, którzy wykonali pożądaną akcję (zakup, rejestracja) |

| View rate | Procent, którzy zobaczyli powiadomienie na ekranie blokady |

| Opt-out rate | Procent, którzy wyłączyli powiadomienia po otrzymaniu testu |

| Time-to-interact | Jak szybko użytkownicy reagują po dostarczeniu |

| Bounce rate | Procent powiadomień, które nie dotarły do odbiorców |

| Retention rate | Długoterminowy wpływ na retencję użytkowników |

Priorytet metryki zależy od celu kampanii. Kampanie re-engagementowe: CTR i time-to-interact. Kampanie konwersyjne: śledź współczynnik konwersji bezpośrednio, nie CTR jako proxy. Eksperymenty z częstotliwością: opt-out rate jest sygnałem, który ma największe znaczenie.

Dobre praktyki testów A/B push

1. Jedna zmienna na test Jeśli wariant B różni się od A jednocześnie treścią, emoji i czasem wysyłki, nie możesz przypisać wyniku żadnej konkretnej zmianie. Jedna rzecz na raz.

2. Prowadź testy do końca Ustaw minimalny czas trwania przed startem. Przerwij wcześnie tylko jeśli wariant aktywnie szkodzi (np. nagły wzrost opt-outów). W pozostałych przypadkach trzymaj się ustalonego okna.

3. Unikaj testowania w niestandardowych okresach Test przeprowadzony podczas Black Friday lub wyprzedaży sezonowej odzwierciedla nienormalne wzorce zachowań. Takie wyniki nie uogólniają się na standardową wysyłkę. Testuj w normalnych warunkach.

4. Priorytetyzuj według wpływu biznesowego 2% wzrost CTR w niskovolumenowym segmencie jest wart mniej niż 15% wzrost w Twojej najcenniejszej kohorcie. Połącz wyniki testów z faktycznym wpływem na przychody lub retencję przed wdrożeniem zmian.

5. Dokumentuj wszystko Prowadź rejestr tego, co testowałeś, hipotezy, wyniku i tego, co zmieniłeś. Bez tego rejestru za sześć miesięcy znowu przeprowadzisz te same testy, nie wiedząc o tym.

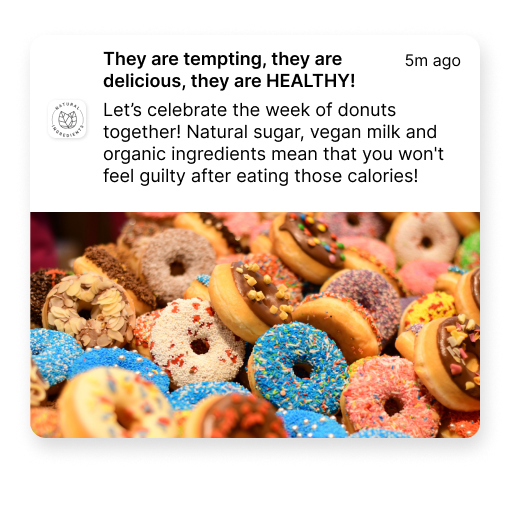

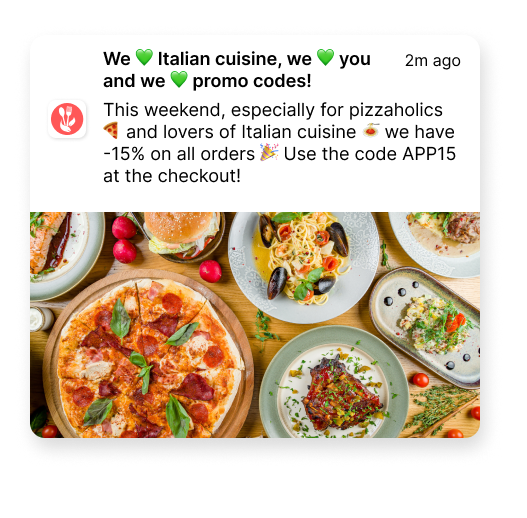

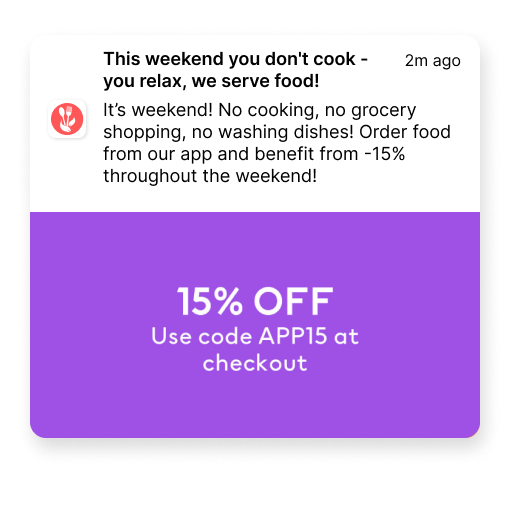

Oto porównanie, jak mogą wyglądać dwa Pushe z tą samą zniżką:

Co zrobić po teście

Wdróż zwycięzcę dla pozostałej bazy odbiorców. Większość platform, w tym MessageFlow, obsługuje automatyczne wdrożenie zwycięzcy po osiągnięciu progu statystycznego.

Następnie zbuduj kolejny test. Każda poprawa bazowego poziomu staje się nową kontrolą dla następnego eksperymentu. Zespoły, które traktują testowanie jako ciągły workflow zamiast okazjonalnego projektu, to te, których metryki push rosną w czasie, zamiast się plateau’ować.

Więcej o budowaniu strategii push powiązanej z wynikami biznesowymi znajdziesz w naszym przewodniku po komunikacji mobile push krok po kroku i w przewodniku po powiadomieniach push w strategii marketingowej.

Testy A/B push z MessageFlow

Platforma MessageFlow Mobile Push obsługuje split testing dla Androida (FCM) i iOS (APNs), z segmentacją odbiorców, grupami holdout i analityką per wariant w jednym widoku. Testuj na pod-segmencie, a następnie automatycznie wdróż zwycięzcę.

CTR, open rate i współczynnik konwersji wyświetlają się obok siebie per wariant w panelu analitycznym. Wybór zwycięzcy to odczytanie liczb, nie eksport arkusza.

Skontaktuj się z nami, żeby skonfigurować pierwszy test A/B push lub przenieść istniejące kampanie do MessageFlow

FAQ: Testy A/B powiadomień push

Testy A/B powiadomień push polegają na wysyłaniu dwóch lub więcej wariantów powiadomienia do oddzielnych segmentów odbiorców, pomiarze wyników każdego wariantu i wdrożeniu zwycięskiej wersji dla reszty kampanii. Między wariantami powinna różnić się tylko jedna zmienna.

Zacznij od treści wiadomości i czasu wysyłki. Te dwie zmienne zwykle przynoszą największy mierzalny efekt. Po ustaleniu wartości bazowych przejdź do sformułowania CTA, emoji i formatów rich media.

Każdy wariant powinien trafić do co najmniej kilku tysięcy odbiorców. Poniżej tego progu wyniki prawdopodobnie nie będą statystycznie istotne. Dokładny próg zależy od bazowego CTR i wielkości różnicy, którą chcesz wykryć.

Kieruj test do pod-segmentu zamiast całej listy. Używaj testowych tokenów FCM lub APNs do walidacji technicznej. Niektóre platformy, w tym MessageFlow, obsługują też grupy holdout, które nie otrzymują żadnego powiadomienia. Są przydatne do mierzenia ogólnego liftu kampanii względem punktu odniesienia.

Minimum to: campaign_id, variant_id, audience_split, variable (co różni się między wariantami) i success_metric. Większość platform obsługuje też duration, winner_selection (ręczne lub automatyczne) i opcjonalne control_group.

Wystarczająco długo, żeby zebrać statystycznie istotną próbę, ale nie tak długo, żeby sezonowość wypaczył wyniki. Dla większości aplikacji z regularną dzienną aktywnością 3–7 dni to rozsądne okno. Nie zatrzymuj testu wcześnie dlatego, że jeden wariant wygrywa.